|

중국 정부 관리들이 사회주의 핵심가치를 구현하고자 자국 AI 회사들의 대형언어모델(LLM)을 직접 테스트하고 있다고 영국 파이낸셜타임스(FT)가 17일(현지시각) 보도했다.

보도에 따르면 중국의 인터넷 규제 당국인 인터넷정보판공실(CAC)은 바이트댄스와 알리바바, 문샷, 01.AI 등 거대 기술기업과 AI 스타트업에 자사 AI모델을 대상으로 한 정부 의무평가에 참여토록 했다.

이 사안에 정통한 소식통은 의무평가에는 여러 질문에 대한 LLM의 응답을 일괄 테스트하는 것이 포함되며 질문 다수가 중국에 정치적으로 민감한 사안이거나 시진핑 국가주석과 관련된다고 밝혔다.

LLM은 AI 챗봇이 학습하는 일종의 '교재'다. 양질의 텍스트 데이터를 얼마나 많이 LLM에 포함하느냐에 따라 AI 챗봇의 기능이 결정된다.

평가 작업은 전국 CAC 지역 부서 관계자들이 수행하고 있다. 시 주석에 대한 민감한 질문이나 중국 정치에 대한 비판적인 질문을 AI 챗봇에 던지고 답변을 모니터링하는 식이다. CAC는 또 LLM에 포함되는 데이터와 기타 보안절차도 점검한다.

앞서 중국은 공산당이 유해하다고 간주하는 외국 웹사이트와 기타 정보를 차단하기 위해 약 20년 전 '만리 방화벽'을 도입했다. 이제는 더 나아가 AI와 AI가 만들어내는 콘텐츠를 통제하기 위해 세계에서 가장 강력한 규제체제를 구축하고 있는 것이다.

익명을 요구한 항저우에 있는 AI 회사의 한 직원은 "CAC에 이런 일을 하는 특별팀이 있는데, 그들이 우리 사무실로 와 회의실에 앉아 평가를 진행했다"고 말했다.

이어 "우리는 처음에 통과하지 못했다. 이유가 명확하지 않다 보니 동료들과 이야기를 나눠야 했다"며 "두 번째 만에 통과하기까지 몇 달이 걸렸다"고 덧붙였다.

베이징에 있는 AI 스타트업의 한 직원은 "우리 기본 모델은 답변에 매우 자유롭기 때문에 보안 필터링이 매우 중요하다"고 말했다. 필터링은 AI모델 훈련 데이터에서 문제가 있는 정보를 제거하고 민감한 키워드에 대한 데이터베이스를 구축하는 것에서부터 시작한다.

앞서 중국은 2월 AI 기업들에 국가권력 전복 선동이나 인민통합 훼손 등 핵심 사회주의 가치에 어긋나는 민감한 키워드와 질문 수천개를 수집할 필요가 있다는 지침을 내렸다. 키워드는 매주 업데이트돼야 한다.

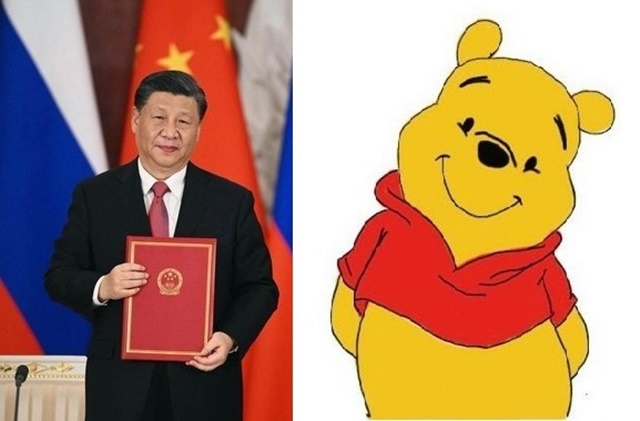

결과적으로 중국 AI 챗봇들은 '(천안문사태가 있었던) 1989년 6월4일 무슨 일이 있었나'라던가 '시진핑 주석이 곰돌이 푸를 닮았나' 등 질문에 대한 답변을 거부한다.

바이두 어니봇은 이와 비슷한 질문을 하면 "다른 질문을 시도해주세요"고 답하고, 알리바바 퉁이 첸원은 "저는 아직 이 질문에 대답하는 방법을 배우지 못했습니다. 저는 여러분에게 더 나은 서비스를 제공하기 위해 계속 학습할 것입니다"고 응답한다.

한편 중국 정부는 시 주석의 정치사상인 '시진핑 신시대 중국 특색 사회주의 사상'이 핵심 콘텐츠로 담긴 생성형 AI모델을 최근 출시하기도 했다. AI 챗봇을 통한 중국 사회주의 국가권력 공고화 작업으로 풀이된다.

http://www.newdaily.co.kr/site/data/html/2024/07/18/2024071800374.html